隨著數據規模的爆炸式增長和業務對實時性要求的不斷提高,大數據處理架構經歷了顯著的演進。從早期的批處理主導,到后來的Lambda架構試圖統一批流,再到以Kappa架構為代表的流處理優先,直至如今流批一體與實時數倉成為主流趨勢,這一演進過程深刻反映了數據處理范式與業務需求之間的動態平衡。

一、Lambda架構:批流結合的經典范式

Lambda架構由Nathan Marz提出,其核心思想是通過并行運行批處理層和速度層(流處理層)來平衡延遲、容錯和可擴展性。批處理層(如使用Hadoop MapReduce或Apache Spark)負責處理全量數據,提供高準確性的“批視圖”;速度層(如使用Apache Storm或Flink)負責處理實時增量數據,提供低延遲的“實時視圖”;最后通過服務層合并兩者結果對外提供查詢。Lambda架構的優勢在于其魯棒性——批處理層可以修正速度層因實時計算可能產生的誤差。其明顯缺點是復雜度高,需要維護兩套獨立的代碼邏輯和計算管道,導致開發、運維成本巨大,且兩套系統的一致性保障頗具挑戰。

二、Kappa架構:流處理統一天下的簡化嘗試

為應對Lambda架構的復雜性,Jay Kreps提出了Kappa架構。其核心主張是:所有數據都視為流,無需獨立的批處理層。系統只需一個流處理層,通過一個可重放的消息日志(如Apache Kafka)來存儲所有輸入數據。當需要全量重新計算或修復邏輯時,只需從頭重新消費消息日志即可。Kappa架構極大地簡化了系統設計,一套代碼處理所有場景。Apache Flink、Apache Samza等流處理引擎的成熟,為Kappa架構提供了強有力的支撐。但其挑戰在于,對消息日志的長期存儲與回溯性能要求極高,并且對于某些復雜的、周期性的全量計算(如歷史數據關聯分析),純流處理模式的效率可能不及批處理。

三、流批一體(Unified Batch & Streaming):架構演進的新方向

流批一體并非一個具體的架構,而是一種設計理念和框架能力,旨在讓開發者能用同一套API和語義同時處理無界流數據和有界批數據。其理想狀態是:開發一次,既能作為流任務低延遲運行,也能作為批任務高吞吐運行。Apache Flink是這一理念的先驅和典范,它通過其底層引擎將批數據視為一種特殊的、有界的流,實現了真正的運行時統一。Google提出的Dataflow編程模型(后由Apache Beam SDK實現)則從更高階的API層面統一了批和流的概念,允許開發者將處理邏輯抽象為PCollection(數據集合)和Transform(轉換),并可以在不同后端引擎(如Flink, Spark, Google Cloud Dataflow)上執行。流批一體解決了Lambda和Kappa架構的核心痛點,降低了開發和維護的復雜性,是當前大數據處理領域的主流方向。

四、Dataflow模型:抽象化的數據處理理論

Dataflow模型由Google在論文《The Dataflow Model》中提出,它不是一個具體系統,而是一個用于定義流批統一數據處理邏輯的理論模型。它核心解決了兩個問題:

1. 數據何時被處理? 通過引入事件時間和處理時間的概念,以及窗口化(固定窗口、滑動窗口、會話窗口等)機制來組織無界數據。

2. 處理結果何時產出? 通過引入觸發器和累積模式(拋棄、累積、累積并撤回)的概念,來精確控制計算結果在何時、以何種方式輸出。

這個模型為流批一體提供了堅實的理論基礎,使得開發者能夠清晰地推理亂序、延遲數據下的計算結果準確性。Apache Beam SDK是這一模型最直接的實現。

五、實時數倉:架構演進的目標與承載

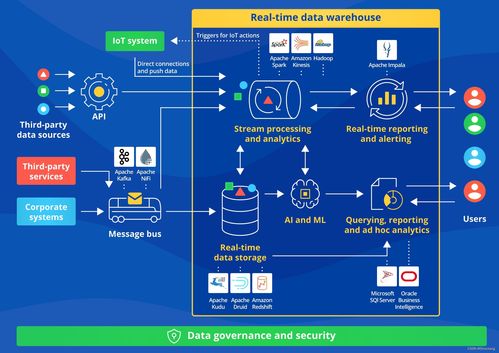

實時數倉是現代數據架構的集大成者,其目標是建立一套能夠同時支持低延遲實時分析(亞秒到秒級)和高效批量分析的數據倉庫系統。它不再是單一的組件,而是一個融合了多種架構思想的完整解決方案:

- 數據接入層:通常基于Kafka等消息隊列,實現數據的實時采集與分發。

- 數據處理層:采用流批一體引擎(如Flink)或混合架構,對數據進行實時ETL、清洗、聚合。

- 數據存儲層:采用分層設計,如ODS(操作數據層)、DWD(明細層)、DWS(匯總層)、ADS(應用層)。存儲選型多樣化,可能包括Kafka(實時管道)、OLAP數據庫(如ClickHouse、Doris、StarRocks用于即席查詢)、鍵值存儲(如HBase用于點查)以及數據湖(如Iceberg、Hudi用于全量歷史數據)。

- 數據服務層:通過統一的查詢引擎或API網關,對外提供一致的數據服務。

實時數倉的本質是讓數據流“實時”地流入并經過處理,直接服務于數據應用,打破了傳統T+1數倉的滯后性。

六、數據處理服務(Data Processing as a Service):云原生的未來

隨著云計算的普及,大數據處理正在向服務化、托管化發展。各大云廠商(如AWS的EMR、Kinesis Data Analytics;阿里云的實時計算Flink版;Google Cloud Dataflow)提供了全托管的數據處理服務。用戶無需關心底層集群的部署、擴縮容、監控和運維,只需專注于業務邏輯開發。這種模式將復雜的架構選擇和技術運維負擔轉移給了云平臺,讓企業能更敏捷地構建實時數據能力,進一步降低了大數據技術的應用門檻。基于云原生的Serverless數據處理服務,結合流批一體與實時數倉理念,將成為企業數據基礎設施的標準配置。

###

從Lambda到Kappa,再到流批一體與實時數倉,大數據處理架構的演進是一條從“分離”走向“統一”,從“復雜”走向“簡潔”,從“技術驅動”走向“業務價值驅動”的清晰路徑。Dataflow模型為此提供了理論基石,而云原生的數據處理服務則讓這些先進架構能夠以更經濟、高效的方式落地。對于架構師和開發者而言,理解這些架構背后的權衡與思想,比單純追求最新技術更為重要。選擇何種架構或組合,應深度結合業務場景的數據特征、時效性要求、準確性要求、團隊技能和成本約束來綜合決定。